Inteligencia artificial responsable

La IA responsable es el conjunto de principios que garantizan que los sistemas de inteligencia artificial sean seguros, equitativos y transparentes. Por ello, tanto el EU AI Act como los principales marcos normativos internacionales sitúan estos principios como base obligatoria para cualquier implantación de IA en entornos regulados.

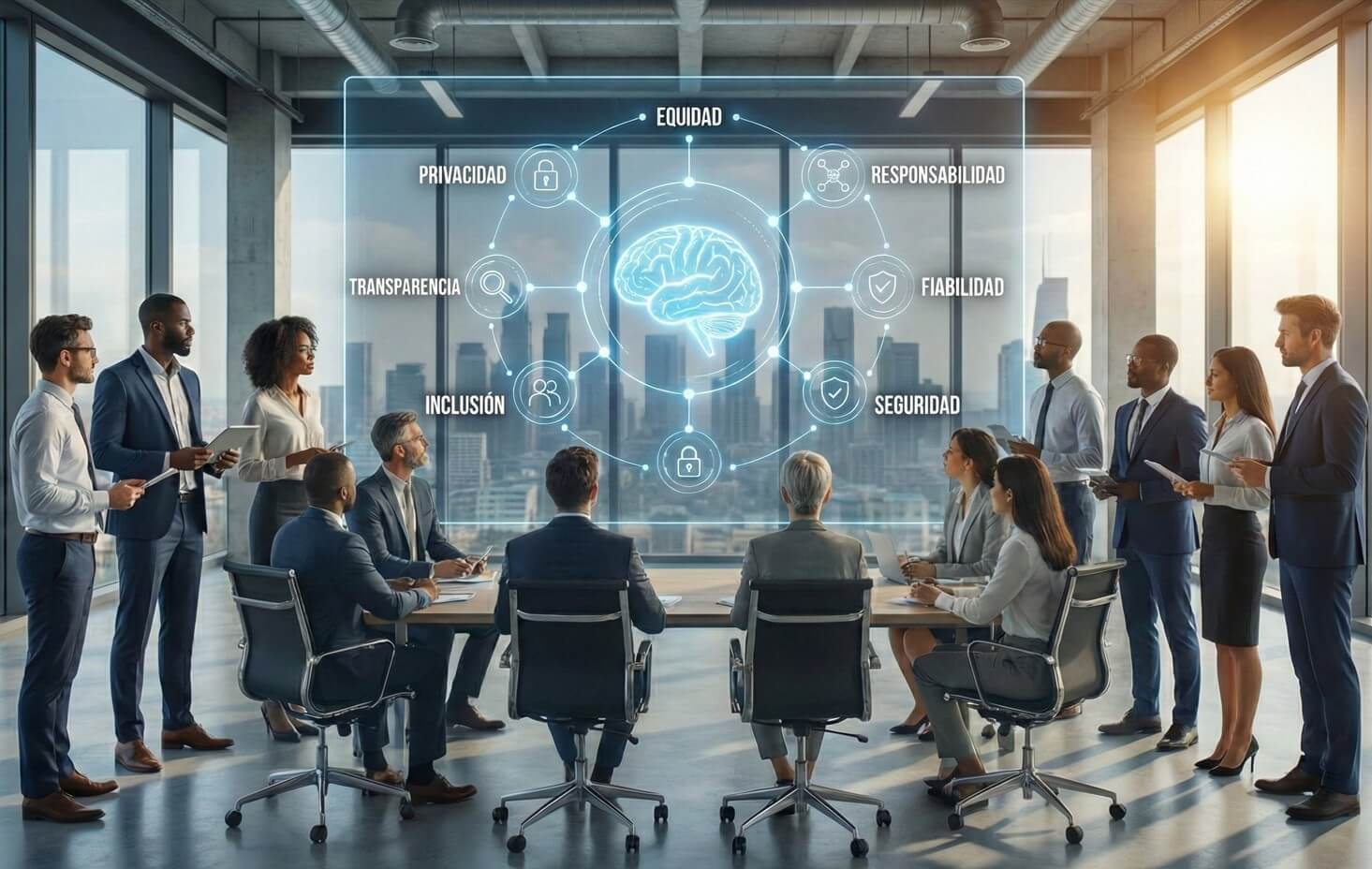

Principios clave de la IA responsable

Los principios de la IA responsable se articulan en torno a seis dimensiones fundamentales. Además, estos principios son vinculantes bajo el marco del EU AI Act para sistemas de alto riesgo.

Equidad y ausencia de sesgo

Los modelos de IA se entrenan con datos seleccionados por humanos. Por tanto, existe un riesgo real de que esos datos reflejen sesgos inconscientes. En consecuencia, los desarrolladores deben auditar los datos de entrenamiento y testear los sistemas para detectar discriminaciones antes del despliegue.

Fiabilidad y seguridad

La IA responsable exige que los modelos probabilísticos sean validados continuamente. Por ello, las aplicaciones críticas deben incorporar mecanismos de validación y planes de contingencia. Además, es necesario definir umbrales de confianza mínimos antes de permitir que el sistema actúe de forma autónoma.

Privacidad y protección de datos

Los modelos se entrenan con datos que pueden incluir información personal. Por tanto, una IA responsable debe cumplir el RGPD y el EU AI Act desde el diseño. En definitiva, la privacidad no es una capa añadida, sino un requisito de arquitectura.

Inclusión, transparencia y responsabilidad

Además de lo anterior, la IA responsable exige que los sistemas sean comprensibles para sus usuarios. Es decir, debe existir explicabilidad de las decisiones automatizadas. Por ello, la transparencia y la trazabilidad son requisitos centrales del EU AI Act para sistemas de alto riesgo.

IA responsable en la práctica: ejemplos reales

En banca, se aplica en la validación de modelos de scoring crediticio para detectar sesgos demográficos. Sin embargo, en seguros el foco está en garantizar que los modelos de predicción no discriminen por factores no relevantes. Por tanto, cada sector regulado tiene su propio perfil de riesgo que el AI Project Manager debe conocer y gestionar.

IA responsable y EU AI Act: obligaciones concretas

El EU AI Act clasifica los sistemas de IA en cuatro niveles de riesgo. Además, los sistemas de alto riesgo como los usados en banca, seguros o RRHH, deben cumplir requisitos específicos de IA responsable: documentación técnica, supervisión humana, registro en la base de datos europea y evaluaciones de conformidad. Por ello, entender estos principios no es opcional para un AI Project Manager en sectores regulados.

Te puede interesar también: implantación de agentes IA en entornos regulados.